过去两周,包括欧盟、美国、澳大利亚在内的多个国家,把青少年使用社群平台与陪伴型 AI 的风险推上政策与舆论焦点,围绕年龄门槛、成瘾性设计与心理健康展开新一轮攻势。

先把目光聚焦在欧盟。此前,《数字服务法》(DSA)已将保护未成年人确立为核心政策目标之一。11月26日,欧洲议会议员高票通过了一份不具法律约束力的报告,呼吁将“使用社交媒体、视频分享平台和陪伴型AI产品”的最低年龄统一设定为16岁,13至16岁的青少年则可以在父母同意的情况下使用。

这项决议的牵头人、丹麦议员克里斯蒂尔·沙尔德莫斯(Christel Schaldemose)在报告中指出,97%的年轻人每天都会使用网络,其中,每四名未成年人中就有一人表现出类似成瘾的使用模式。沙尔德莫斯呼吁,禁止平台对未成年人使用基于互动的推荐系统,并默认关闭其他具有成瘾风险的功能,包括无限滚动、自动播放、下拉刷新、奖励循环以及有害的游戏化机制。

(欧洲议员以 483 票赞成、92 票反对、86 票弃权通过了这份报告。该决议不具有法律效力,未来立法需要欧盟委员会提出完整提案。)

澳洲则已经走到执法前线。11月21日,澳大利亚互联网监管机构表示,将把亚马逊旗下直播服务平台Twitch列入青少年禁用名单。并且,去年11月,澳大利亚通过法案,要求多个社交媒体平台停止对16岁以下未成年人提供服务。这项法令将于12月10日正式启用,违者最高可被处以4950万澳币(约合2.3亿元人民币)的罚款。

目前,列入禁令名单的主要平台包括Facebook、Instagram、Snapchat、Threads、X、YouTube。根据澳政府的公开文件,其对于“社交媒体”的定义是:

主要功能是让人与人在线上互动;

用户可以加好友、关注彼此、聊天、留言、点赞等,与他人联系;

用户可以自己发布内容,如发布文字、照片、影片、开设直播,让他人看到和回应

论战来到美国,争议焦点则集中在心理健康与责任归属。11月21日,莫特利·赖斯律师事务所(Motley Rice)代表美国多个学区提起诉讼。控告Meta、谷歌和Snapchat故意隐匿内部研究结果。原告指出,在2021年一项代号为“水星计划”(“Project Mercury”)的内部研究项目中,Meta发现“用户停用Facebook一周之后,他们的抑郁、焦虑、孤独感和社交攀比情绪有所降低。”原告指控,得出这个结论之后,Meta隐瞒并取消了进一步研究,此举无异于将用户心理健康问题悬置。听证会定于1月26日在北加州地方法院举行。

监管端也在行动。就在同一天,加州总检察长(AG)Rob Bonta宣布与移动游戏开发商Jam City达成140万美元(约合991万元人民币)和解,对其旗下21款手游的隐私违规行为进行处罚。理由是该公司在未获得儿童与青少年授权的情况下,擅自收集并共享数据,违反儿童隐私保护规定。

值得注意的是,AI聊天机器人成为本轮美国针对青少年监管的重点。

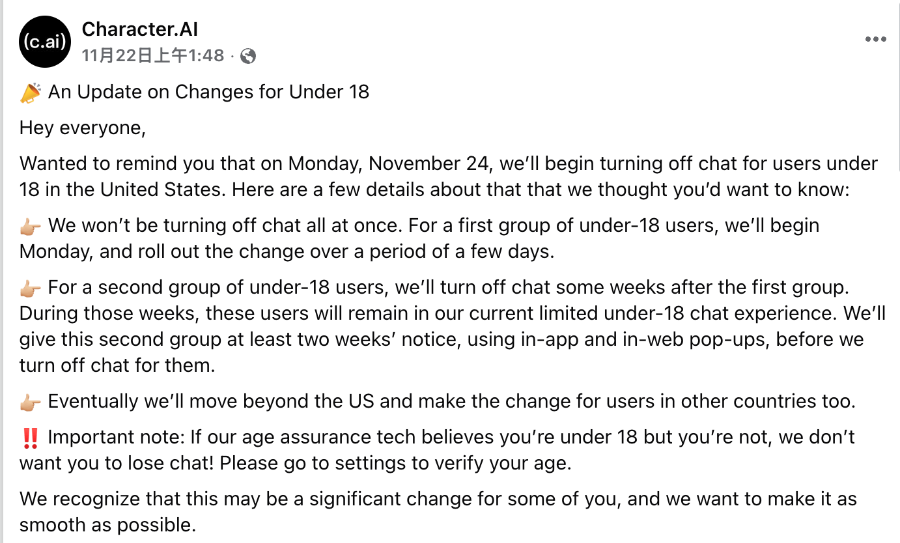

11月17日,Anthropic、苹果、谷歌、OpenAI、Meta、微软和学界专家齐聚斯坦福大学,举行了一场为期八小时的闭门研讨会,就聊天型AI机器人对青少年的影响展开讨论。多个AI巨头承认,仍然有空间可以采取更多措施以加强保护弱势群体。随即,深受美国青少年欢迎的Character.AI宣布,自11月24日起将停止对美国未成年人提供服务。

(Character.AI表示,将分批次停止对美国未成年人提供服务,并希望最终可以影响到更多国家。)

行业的反应一定程度上是应对监管的举措。众议院能源暨商务委员会旗下的监督与调查小组委员会于 11 月 18 日就 AI 聊天机器人举行听证会,聚焦其可能诱发或加剧心理健康危机的风险。

斯坦福大学研究院詹妮弗·金(Jennifer Kin)提醒,由于AI聊天机器人不受美国《健康保险流通与责任法案》(HIPAA)的约束,用户在对话中吐露的高敏感信息多半会被用于模型训练。因此,研究人员建议国会要求开发者提高训练数据与数据处理流程的透明度,并支持公共机构开展相关影响研究,进而制定聊天机器人提供心理健康服务的最低标准及行销规范。

在更早之前,加州签署了全美首个AI陪伴聊天机器人法案,在全球范围内引发了广泛关注。法案率先为未成年人制定了具体的保护措施,例如每三小时提醒休息,禁止向未成年人提供色情内容,并赋予了未成年人私人诉讼权,这可能使企业面临民事诉讼。

富而德律师事务所人工智能业务全球联席主管Anna Gressel分析称,这只是人工智能安全监管趋势的一部分。“为了应对日益复杂的州级监管法规并管理不断增长的诉讼风险,企业应考虑是否有必要披露人工智能信息并制定安全协议。此外,对许多公司而言,积极关注人工智能领域的法律动态也至关重要。”她指出。

从互联网到AI时代,围绕未成年用户的监管一直是老大难,其既受到社会舆论影响,亦有商业考量。富而德律师事务所合伙人、数据和科技业务全球联席主管Christoph Werkmeister博士指出,随着AI的普及,隐私泄露、成瘾设计等旧问题被进一步放大,变得更加尖锐。

在他看来,大多数监管机构并非一刀切地监管服务本身,而是更具体地聚焦于应当落实哪些保障措施。Christoph Werkmeister认为,监管需要更加谨慎,既要避免过度监管,也要密切关注对现实生活的影响。

围绕AI的青少年模式,从欧盟到美国,再到率先祭出禁令的澳洲,也从抽象的“技术焦虑”,走到具体的年龄门槛、成瘾设计和数据透明要求。真正的难题,早已不在于要不要监管,而是如何在保护青少年与保留技术想象力之间,画出一条足够清晰、灵活的边界。