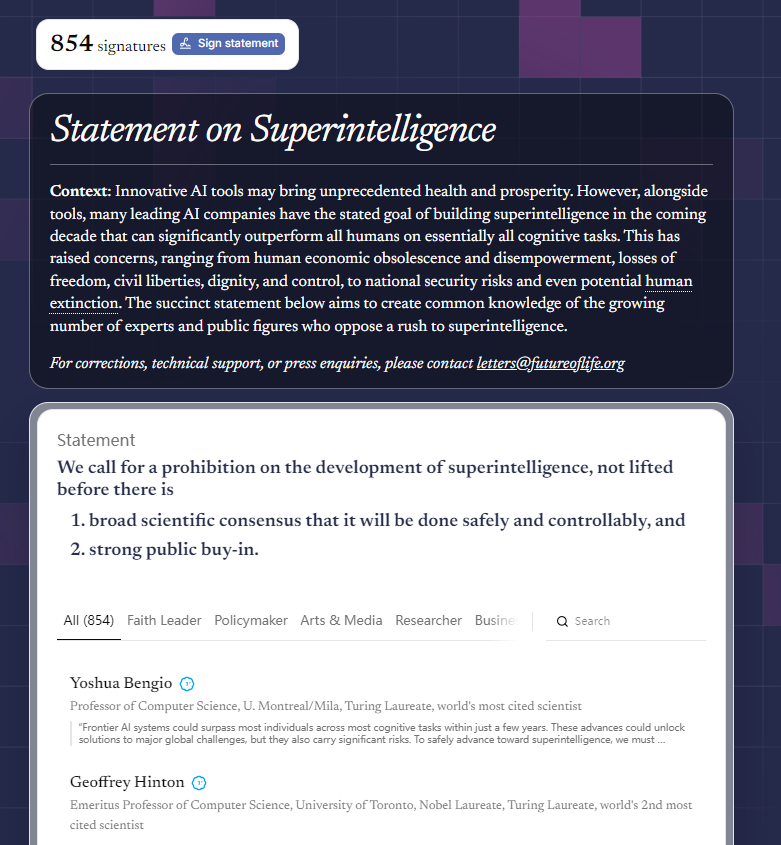

包括苹果联合创始人史蒂夫·沃茲尼克(Steve Wozniak)和维珍集团董事长理查·布兰森(Richard Branson)在内的800多名知名人士,近日签署了一份公开声明,要求立即停止超级智能的开发。

“超级智能”是指在所有领域超越人类认知能力的人工智能系统。

这个史无前例的联合声明警告称,超越人类智能的人工智能(AI)系统带来了从经济崩溃到人类灭绝的风险。该声明等同于直接向OpenAI、Meta和其他科技巨头正在大肆鼓吹的AI模型竞赛“泼了一盆冷水”,可能成为AI行业的一个重大转折点。

据悉,这份联合声明的签名名单包含了世界上最有影响力的科技领袖、科学家和公众人物,甚至就连被广泛认为是现代人工智能教父的约书亚·班吉欧(Yoshua Bengio)和杰佛瑞·辛顿(Geoffrey Hinton)也在其中。

“超级智能的前景已经引起了人们的关注,其影响从人类经济的落伍和权力的剥夺,自由、公民权力、尊严和控制权的丧失,到国家安全风险,甚至可能导致人类灭绝,”签名者用直言不讳的语言警告说。

这不仅仅是学术上的绝望。就在这份请愿书发布之际,Meta将其人工智能部门更名为“Meta超级智能实验室”(Meta Superintelligence Labs),而OpenAI和马斯克(Elon Musk)的xAI则陷入了一场越来越公开的竞赛,看谁能首先实现人工通用智能。

但这些行业资深人士却在此时呼吁“踩刹车”,希望不要发展太快。

不仅如此,这份联合声明签名者名单的覆盖范围远远超出了硅谷。前国家安全顾问Susan Rice和前参谋长联席会议主席Mike Mullen都签名支持,这表明了对国家安全的严重担忧。甚至连英国王妃梅根·马克尔也出现在名单上,与特朗普的盟友史蒂夫·班农和格林·贝克一起——这种政治团结实属罕见。

加州大学伯克利分校(UC Berkeley)的Stuart Russell是一位领先的人工智能安全研究员,多年来一直在对超级智能发出警告,他帮助组织了这项工作。根据他之前的研究,挑战不在于人类能否建立超级智能系统,而是一旦它们存在,人类能否控制它们。

该声明呼吁全面禁止超级智能的发展,“直到公众强烈支持并达成广泛的科学共识,即它可以安全可控地进行。这是一个很高的标准,它可能会有效地冻结当前人工智能开发的时间表。”

这份联合声明与此前任何相关警告都不同,这里面的许多人都并非来自“外界”,恰恰相反,他们是建立了今天的人工智能能力的研究人员和企业家。当班吉欧和辛顿之类的顶级科学家——他们的工作使现代大型语言模型得以实现——说“踩刹车”时,整个行业很可能会认真思考。

不过,接下来会发生什么,可能取决于各国政府如何应对。欧盟已经在实施人工智能法规,美国一直在探索人工智能安全框架。这份请愿书为立法者提供了借口,可以对最先进的人工智能研究实施更严格的控制。