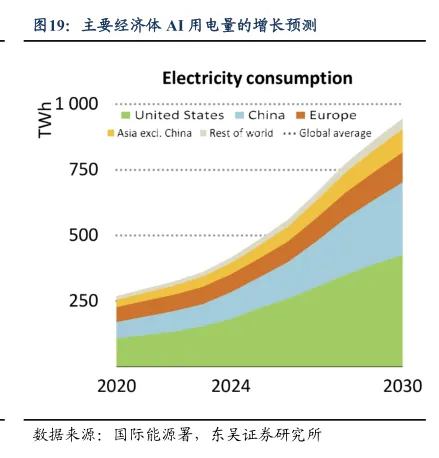

#IDC电力短缺阻碍AI发展!解决方案有哪些?# $电源设备(BK1034)$

最近英伟达搞了个动作,邀请了一堆解决“数据中心电力问题”的初创公司开会。这事儿很说明问题:AI的瓶颈,正在从芯片制造转向电力供应。

我们看AI,往往只看模型多大、参数多强,但支撑这一切的,是实打实的电。现在的AI数据中心,功耗密度极高,传统的供电和散热方案已经快跟不上了。简单说,AI的本质,就是耗电。

这就逼着我们重新审视现有的发电方式,看看谁能撑起AI的未来。

现有的发电方式,各有什么问题?

要给AI供电,核心就两个要求:一是量要大,二是要稳。 咱们挨个看:

1. 火电(煤电):

优点: 稳定,想发多少发多少,技术也成熟。

缺点: 污染大,碳排放高。现在全球都在搞碳中和,再大规模上火电,政策上过不去,成本也会因为碳税越来越高。而且,很多科技公司都有绿色承诺,不可能靠烧煤来跑AI。

2. 风电和太阳能:

优点: 绿色,成本越来越低,资源丰富。

缺点: 太不稳定。 风不是一直有,太阳不是一直晒。AI数据中心需要的是24小时不间断供电,中间要是断了或者电压不稳,芯片可能就烧了。虽然可以配电池储能,但目前的储能技术,要支撑大规模、长时间的算力需求,成本太高,技术也没完全成熟。

3. 核电:

优点: 能量密度极大,非常稳定,而且是零碳排放。一块小小的核燃料,能发很久的电。

缺点: 建设周期长,审批严,公众对安全有顾虑,废料处理麻烦。但客观讲,从能量密度和稳定性上,它是目前最适合给大型数据中心供电的能源。

未来的趋势会怎么走?

基于上面的分析,未来的局面很可能是这样的:

1. 核电会重新被重视。 你看微软、亚马逊这些巨头,都在谈跟核电公司合作。原因很简单,别的电要么不够稳,要么不够绿。小型模块化核反应堆(SMR)可能会成为大型智算中心的标配,或者数据中心会直接建在核电站旁边。

2. “算电协同”会成为常态。 既然电有时候不够或者不稳定,那AI就得学会“灵活”。比如,利用AI算法预测电网负荷,在电价低、电能充裕的时候全力训练模型;在用电高峰的时候,自动降低算力消耗。让算力去适应电网,而不是反过来。

3. 数据中心会“逐电而居”。 就像工厂要建在煤矿附近一样,未来的数据中心会往能源丰富的地方跑。比如中国的“东数西算”,把算力需求搬到西部,利用西部丰富的风电、光电和水电。或者往北欧、加拿大这些水电、风电资源好又冷的地方搬,既解决了电的问题,又解决了散热的问题。

说“AI的尽头是电力”,不是说算法不重要了,而是说能源是AI发展的硬约束。

如果不解决电的问题,芯片再强也跑不起来。对于咱们关注这个领域的来说,眼光不能只盯着芯片厂,还得盯着发电厂和电网。 谁能把便宜、稳定、绿色的电搞定,谁就能在AI时代掌握主动权。

#周末杂谈# #复盘记录# #炒股日记# #收盘点评#