百度最新开源一款轻量化模型 适用于学术科研等长文本推理场景

来源:上海证券报·中国证券网

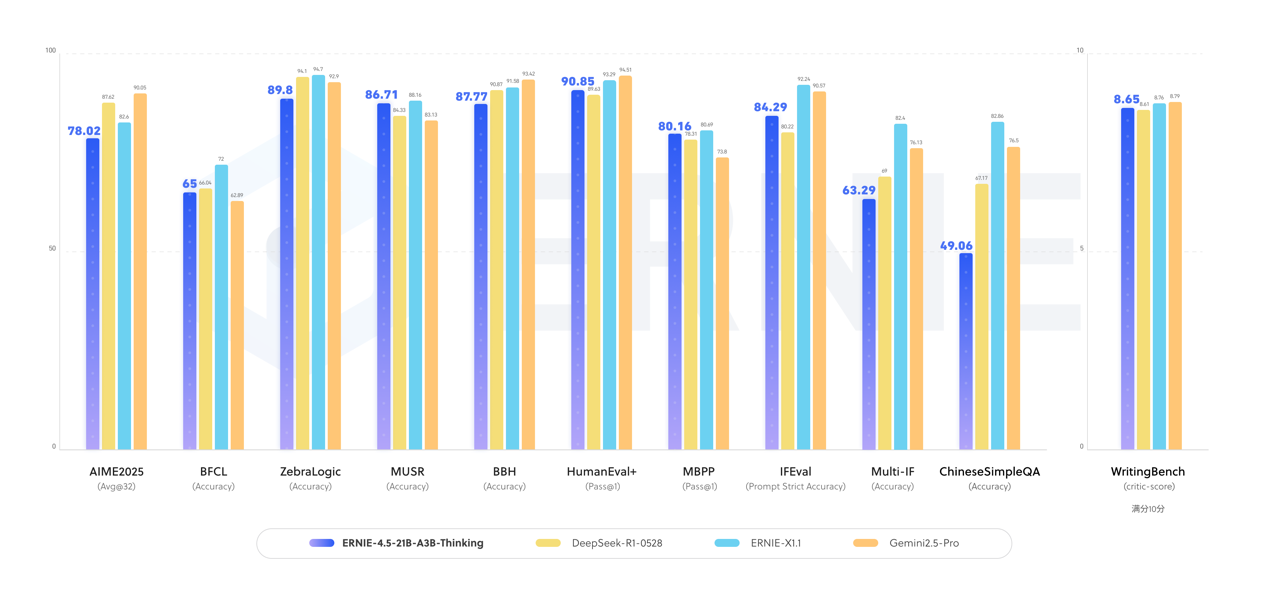

在9月9日举行的WAVE SUMMIT深度学习开发者大会2025现场,百度正式开源最新的思考ERNIE-4.5-21B-A3B-Thinking。据悉,该模型不仅在逻辑推理、数学、科学,代码与文本生成等需要人类专家的任务上实现了显著提升,还具备高效的工具调用能力,能够支持复杂任务的自动化处理。

据介绍,ERNIE-4.5-21B-A3B-Thinking采用了混合专家(MoE)架构,总参数规模达210亿,每个token激活 30 亿参数,通过指令微调及强化学习训练。ERNIE-4.5-21B-A3B-Thinking是在ERNIE-4.5-21B-A3B 基础上训练的深度思考模型,该模型支持128 的上下文窗口,适用于需要长上下文的复杂推理任务。

此外,ERNIE-4.5-21B-A3B-Thinking 模型以Apache License 2.0协议开源,允许商业使用。该模型已在HuggingFace、星河社区等主流开源社区同步发布,FastDeploy、 vLLM、Transformers 等开源工具已经实现了对该模型的支持,可以直接加载模型并使用。

公开资料显示,今年6月30日,百度正式开源文心大模型4.5系列模型,涵盖47B、3B激活参数的混合专家(MoE)模型,与0.3B参数的稠密型模型等10款模型,并实现预训练权重和推理代码的完全开源。目前,文心开源系列模型已在行业中得到广泛应用。

当日,百度还正式发布文心大模型X1.1深度思考模型,该模型在事实性、指令遵循、智能体等能力上均有大幅提升。目前,用户可以在文心一言官网、文小言APP使用文心大模型X1.1。文心大模型X1.1已正式上线百度智能云千帆平台,对企业客户及开发者全面开放使用。

郑重声明:用户在财富号/股吧/博客等社区发表的所有信息(包括但不限于文字、视频、音频、数据及图表)仅代表个人观点,与本网站立场无关,不对您构成任何投资建议,据此操作风险自担。请勿相信代客理财、免费荐股和炒股培训等宣传内容,远离非法证券活动。请勿添加发言用户的手机号码、公众号、微博、微信及QQ等信息,谨防上当受骗!

评论该主题

帖子不见了!怎么办?作者:您目前是匿名发表 登录 | 5秒注册 作者:,欢迎留言 退出发表新主题

温馨提示: 1.根据《证券法》规定,禁止编造、传播虚假信息或者误导性信息,扰乱证券市场;2.用户在本社区发表的所有资料、言论等仅代表个人观点,与本网站立场无关,不对您构成任何投资建议。用户应基于自己的独立判断,自行决定证券投资并承担相应风险。《东方财富社区管理规定》